今天,兰亭妙微UI设计公司分享的是「常见的交互设计套路」。

不知道大家有没有过这种体验,睡前拿起手机刷短视频,原本打算看几条视频就睡觉,结果刷着刷着一两个小时就过去了。

那么我们为什么会忍不住一直“刷刷刷”呢,这种设计背后藏着哪些交互逻辑。今天就来好好聊聊这个话题。

什么睡前刷短视频,原本只想看几条,却不知不觉耗掉一两个小时?这种让人停不下来的体验,并非偶然,而是产品背后一套成熟的交互设计机制在引导行为。本文拆解让用户沉浸的核心套路,分析其利弊,并给出良性设计的原则。

一、引导用户沉浸的 4 种典型交互

这些无需动脑的操作,用低门槛、强反馈的方式持续抓住注意力,让用户在无意识中持续使用产品。

1. 无限滚动

通过算法消除页面终点,持续推送新内容,用户只要滑动就能看到新信息。

它利用人的

FOMO(害怕错过)心理,让人总觉得 “下一条更精彩”,进而不停滑动。省去分页操作、隐藏内容终点,是内容平台提升停留时长的经典设计。

2. 自动播放

视频结束后自动播放下一条,替用户省去点击与决策成本。

看似便捷,实则在用户未做出选择前就

替用户决定继续观看,大幅延长使用时长;搭配 “查看更多相似内容” 提示,还能进一步延迟用户退出。

3. 下拉刷新

初衷是方便用户快速获取新内容,操作简单顺手。

如今已演变成

习惯性触发机制,用户会重复下拉,期待不可预测的 “小惊喜”,形成停不下来的刷新行为。

4. 红点与消息反馈

以小红点为代表的角标(Badge),本用于提醒重要信息,但过量的 “99+” 提示会制造心理压力,让用户觉得 “有未处理事项”,忍不住点击查看。

部分产品已优化:提供

一键清除未读、

仅显示好友直接互动等功能,减少用户焦虑。

二、功能的两面性:从好体验到 “操控式设计”

这些交互最初都是为提升易用性而设计,核心是通过心理引导优化行为。但一旦过度,就会剥夺用户自主权,变成隐性操控,甚至沦为暗黑模式。

暗黑模式:用界面或交互故意误导、操纵用户决策,看似友好,实则诱导点击、违背用户意愿。上述沉浸型交互,很容易跨过边界变成套路。

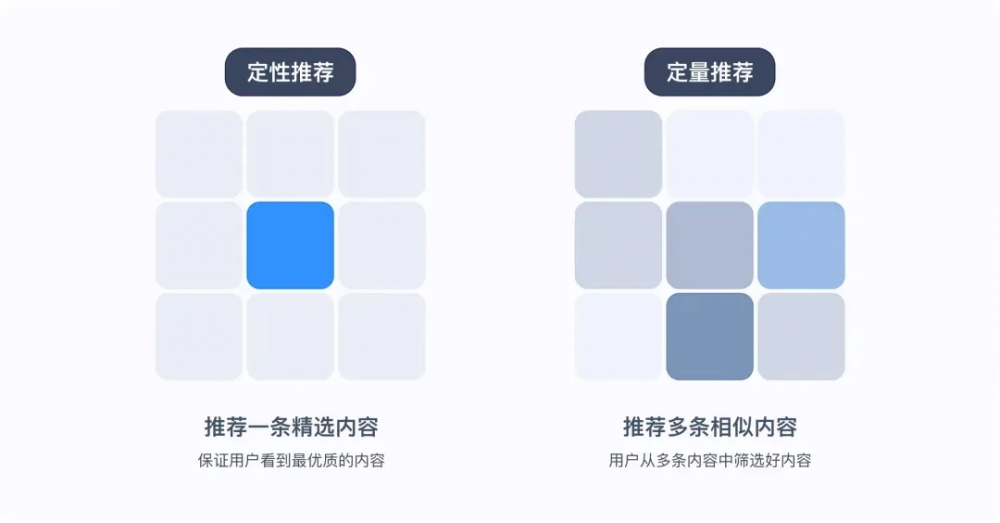

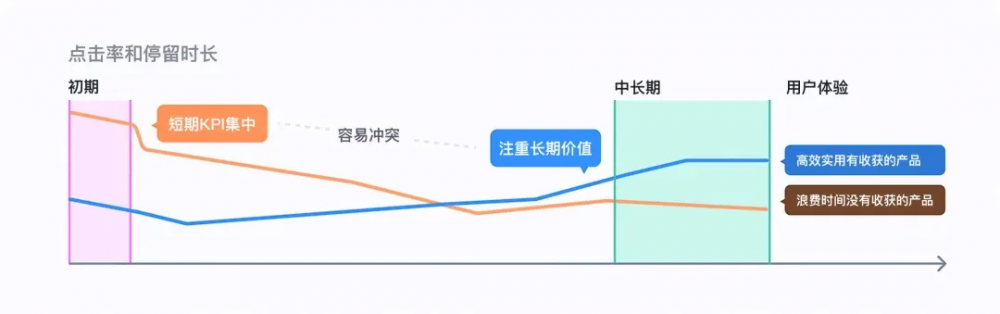

过度追求点击量、播放量、停留时长等

短期数据,会让平台只注重无限推送,而非优质内容。用户刷完后往往感到空虚、浪费时间,长期会降低品牌信任。

短期数据好看≠长期用户忠诚,好产品的目标是留住用户,而非 “耗走” 用户。

三、良性引导用户的 3 个设计原则

1. 提供终点,保留用户决策权

对需要深度阅读的高质量内容,建议采用有终点的结构,而非无限滚动。明确的结束点能带来 “完成感” 与成就感,让用户更专注内容本身。

2. 适度反馈,拒绝过量刺激

控制通知与红点数量,只推送真正重要的信息。避免无意义提醒带来的焦虑与疲惫,让反馈成为正向激励,而非心理负担。

3. 少套路,多真诚

通知与推荐以传递真实信息为主,减少 “再不看就没了” 等制造焦虑的话术。短期套路或许能提升点击,但长期会引发用户反感。

结语

优秀的用户体验,核心是

赋予用户自主权。自动化、便捷化的交互本身没有错,但必须让用户能自主控制:什么时候看、看多少、什么时候停。

好设计不是强迫停留,而是让用户愿意停留、愿意再来。以用户为中心的良性交互,才能带来可持续的体验与口碑。

转载:优设